- 软件内置了OLLAMA的一些操作,方便本地使用

使用软件内置安装

本机已经部署的OLLAMA

- 指定本机的OLLAMA所在文件夹

假如可执行文件路径为

C:\data\shb\ollama\ollama.exe,那么配置如下

"shenghuabi.ollama.dir": "c:\\data\\shb\\ollama",

参考

使用本机的OLLAMA但是已经启动

上面两种都是由软件启用OLLAMA,用户不需要关心

如果指定了shenghuabi.ollama.dir但是不由软件启动,也可以使用下载模型操作

- 关闭软件启动OLLAMA

"shenghuabi.ollama.startup": false,

- 指定api路径(如果有修改)

"shenghuabi.chat": {

"baseURL": "http://127.0.0.1:11434/v1",

},

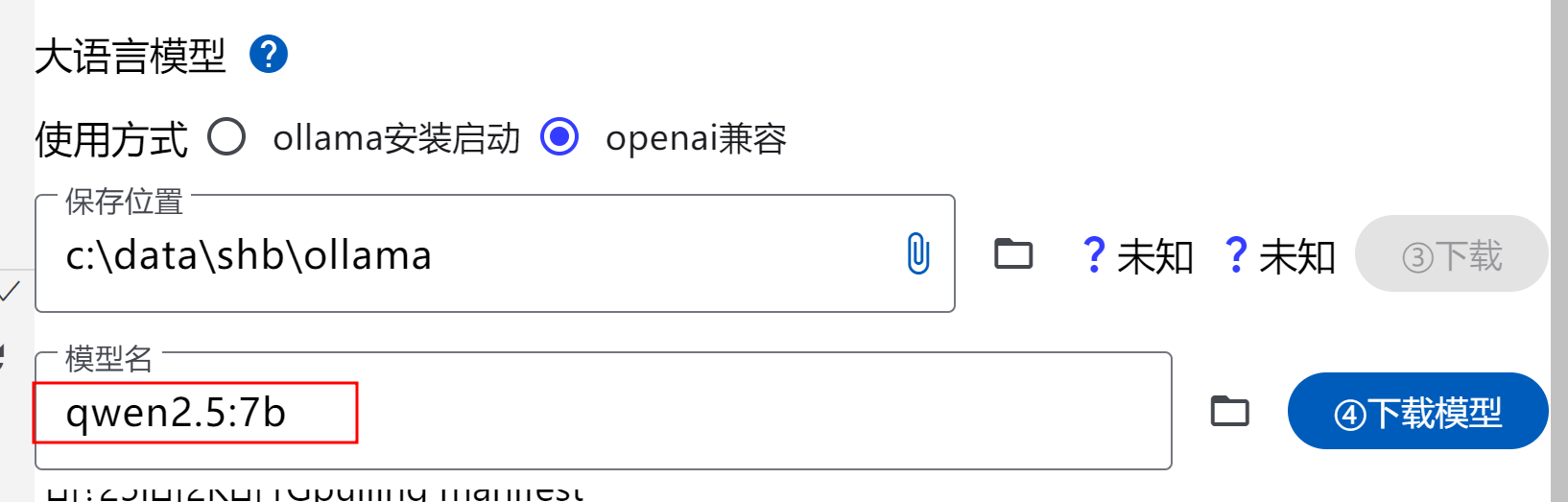

下载模型

环境配置页面,修改模型名然后点击下载

下载完成后会自动修改使用,如果下载到9x%后速度变慢,可以再次点击,杀掉之前的进程,下载进度会保留,速度会恢复

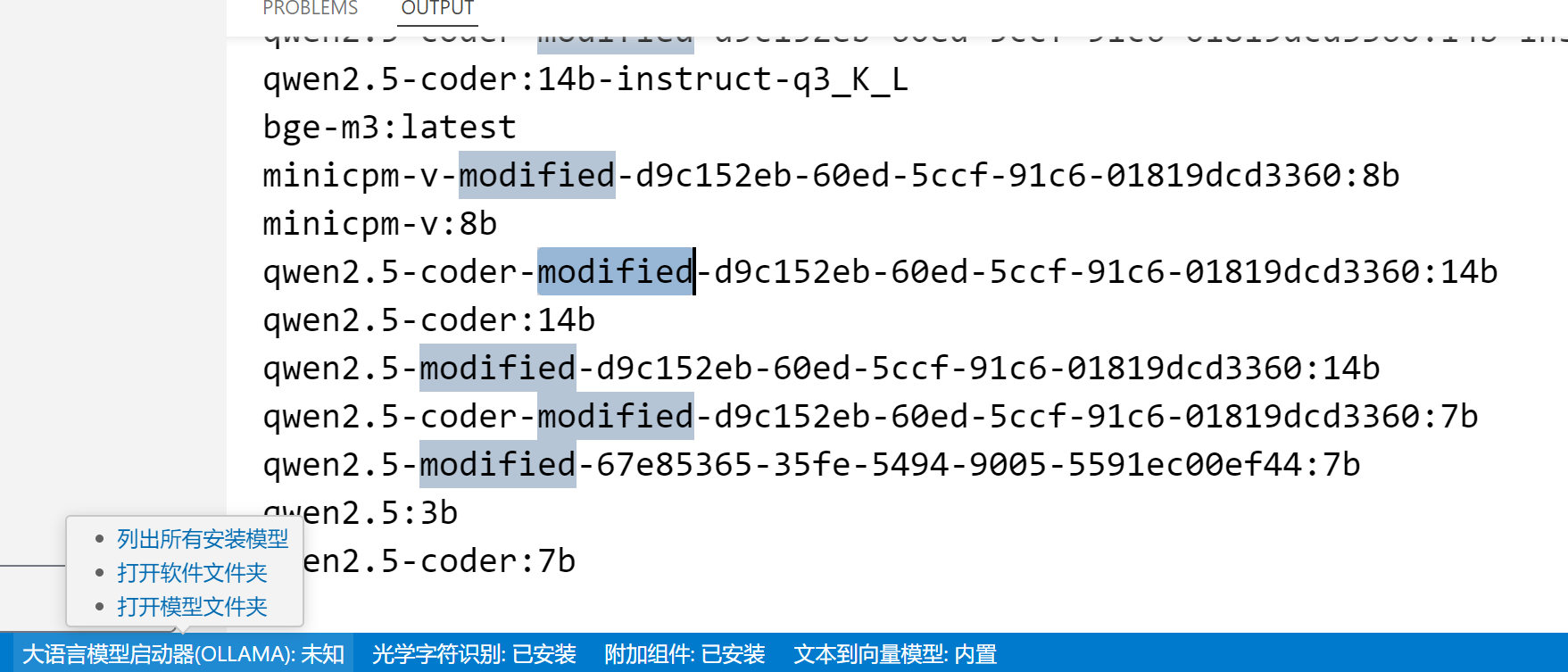

列出模型

- 最下面的状态栏悬停显示

- 带

modified的模型表示这个模型被修改过(比如上下文长度)

这个是由软件在调用时自动实现的,不需要关心

自动生成的模型尺寸并非列举出来的那么大,可以理解为docker的层,只多了一个配置层

目前已经不会再生成带modified的模型,因为ollama新版已经有设置上下文长度的环境变量

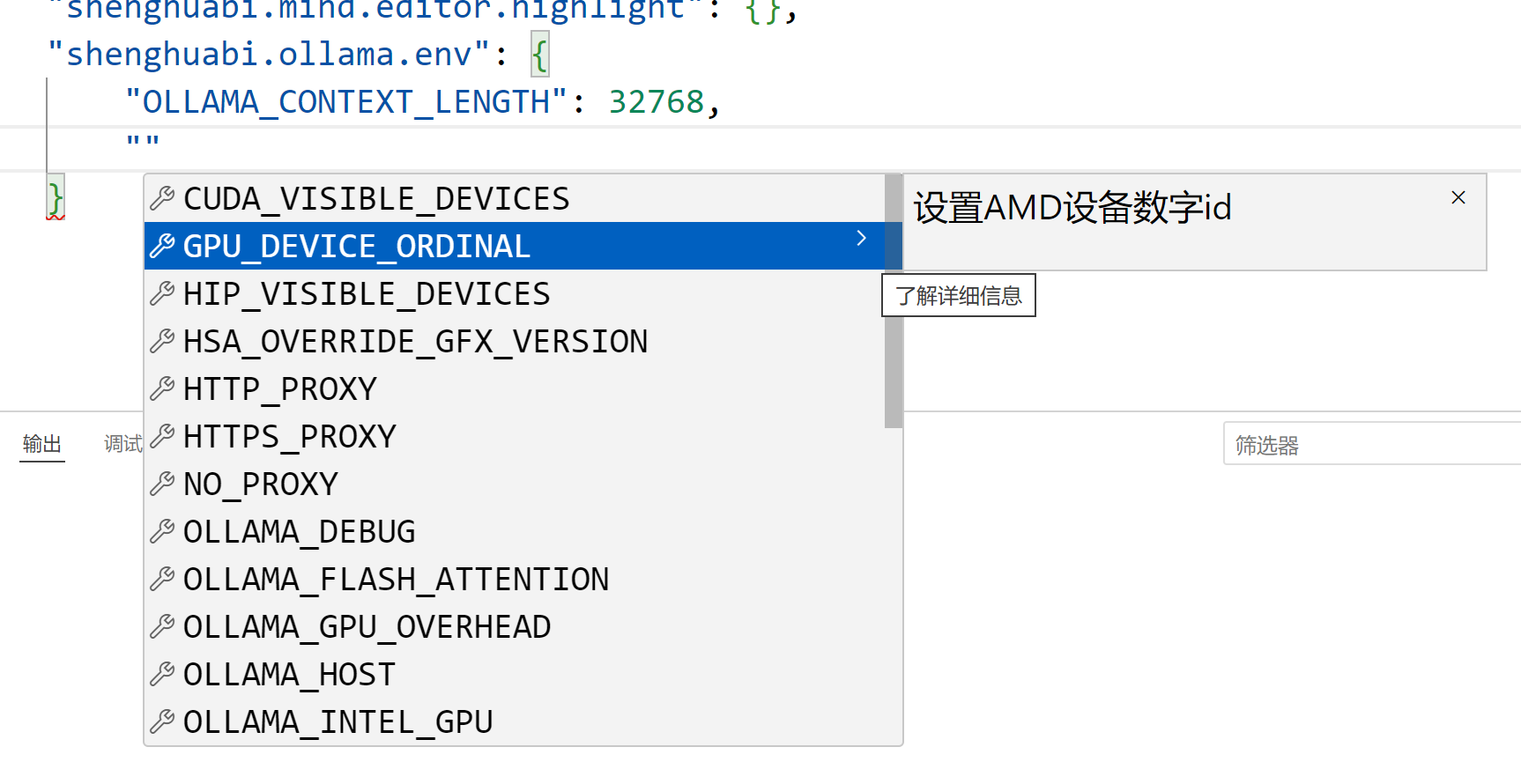

环境变量

- 环境变量在配置中有相应提示

- 修改模型上下文长度

如果这个值设置的过小,那么如果一条提示词过长时会直接抛弃,一般在知识图谱提取时使用

ollama默认为2048,软件默认设置为32768

"shenghuabi.ollama.env": {

"OLLAMA_CONTEXT_LENGTH": 32768

}