-

目前本地大语言模型使用的是Ollama,优点就是包装的很好,开箱即用;但是缺点就是它对于某些特性适配太慢了.比如rwkv好像9月份llama.cpp就适配了,结果现在也没有支持

-

还有就是vulkan,llama.cpp一直有vulkan的包,但是也没加上

-

如果由ollama改为llama.cpp,这两个问题就都能解决,但问题是llama.cpp并没有量化任何模型的包,虽然可以借用ollama的服务器下载,但是万一未来出现啥兼容问题感觉也比较麻烦…

-

还有一个就是谁也不知道ollama会不会再未来某个时间突然适配了这两点(有pr,但是一直没合并),单独为了这两点适配有点得不偿失(毕竟不是说现在用不了,而是一个优化性质的功能)

-

当然最主要的是搞这个功能可能会耽误其他功能的开发并且rwkv目前的性能和qwen2.5比起来感觉有点弱(rwkv6好像和llama3 8b性能类似?,但是现在都迭代了快一年了)

那就暂时不忙更换

RWKV 现在不行啊,续写相当抽卡写,就是运行14B-20B模型,token数量多有优势,其他毫无优势。(不知道是不是藏拙了)

如果不设计角色卡、开放章节细纲,估计就到此为止了。

现在qwen2.5:7B已经适用大多数人物情况了。

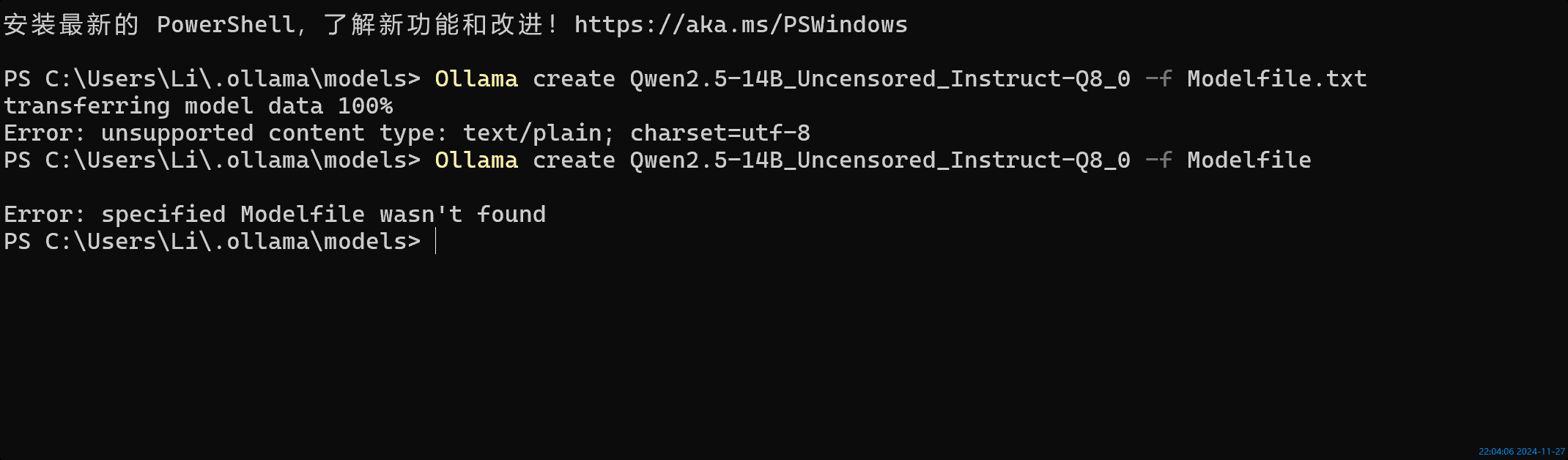

就是14B的gguf模型不知道怎么导入软件本地的ollama

14b也可以使用把.我用过14b的

你的意思是自己下载的gguf模型再ollama中使用?

我找下方法,

rwkv的有点可能就是无限长度吧(别管有没有用,反正不限制…)

另外就是最近rwkv7快出来了.可能会和其他模型掰腕子?

问下您说的那个无法识别是啥问题?没看懂

没错,折腾了一下,发送生花笔下载的OLLAMA,无法在cmd上查到模型,只能到官网再次安装OLLAMA,之后启动才可以查询,接着是想直接在OLLAMA新安装位置上启动命令导入模型,但是又发现端口被占用了,再次打开生花笔显示OLLAMA启动失败,估计是两个冲突了。

然后我就一直找生花笔OLLAMA目录下要在哪导入模型,没发现。

我修改回答了,已经解决了,

默认是这个位置C:\\Users\\<用户名>\\.ollama\\models

看起来快搞好了.

不过最近也确实没时间移植这个llama.cpp,除非rwkv突然爆发,否则还要靠后

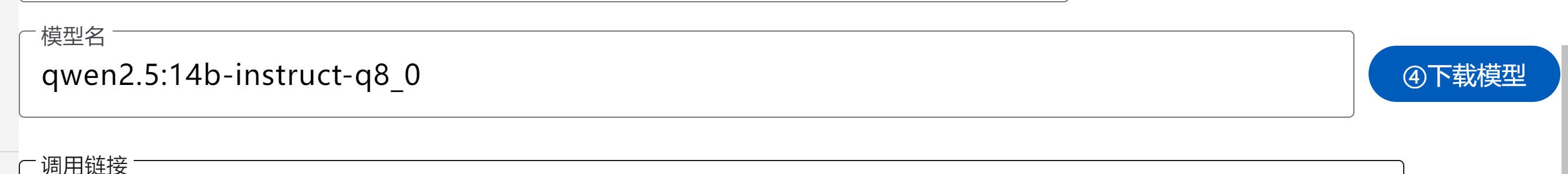

要么直接用软件下载qwen2.5:14b-instruct-q8_0?

确实要指定这个modelfile文件,但是我不知道你这个文件格式对不对

我记得好像是要有来源镜像,模板啥的,你写的这个名字应该是创建好的名字

我知道可以,事实上一开始是想导入RWKV的模型的,可惜也没成功,那时候怀疑是架构影响,又换了其他测试

有没有可供下载的模型列表,非qwen模型总是显示找不到模型,官网10B以上的模型的量化分类很少

不知道本地能不能看到啊.Ollama 这里可以搜索模型

很奇怪哦,我也找了官网的,显示找不到ip

Error: Head “https://dd20bb891979d25aebc8bec07b2b3bbc.r2.cloudflarestorage.com/ollama/docker/registry/v2/blobs/sha256/b5/b506a070d1152798d435ec4e7687336567ae653b3106f73b7b4ac7be1cbc4449/data?X-Amz-Algorithm=AWS4-HMAC-SHA256&X-Amz-Credential=66040c77ac1b787c3af820529859349a%2F20241129%2Fauto%2Fs3%2Faws4_request&X-Amz-Date=20241129T144242Z&X-Amz-Expires=1200&X-Amz-SignedHeaders=host&X-Amz-Signature=e9e9e0c106e74c26bb08ae7e31cc9da7a3bf57bf2c190cde82a432317c51b8b3”: dial tcp: lookup dd20bb891979d25aebc8bec07b2b3bbc.r2.cloudflarestorage.com: no such host

重启又可以了

你这本地看不到整个网站?可能cf被污染了.我记得好像有时候是好用,有时候不好用

目前确实没提供列表,因为我以为大家都能搜索到呢(另外就是国内效果不错的模型也就是qwen了,其他的我测试过一般)

事实上这里我已经加镜像了(transformers的模型,ollama,qdrant软件的下载),但是ollama本身能访问我就没加.刚才测试了下好像全国都可以访问? ollama.com_在线ping_多地ping_多线路ping_持续ping_网络延迟测试_服务器延迟测试

https://hf-mirror.com/。在这个网站我复制一些模型名,都下载失败了,显示:Error: pull model manifest: file does not exis